AI

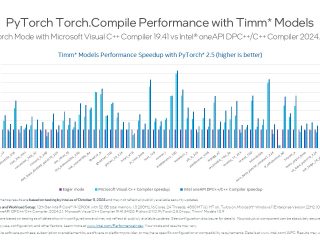

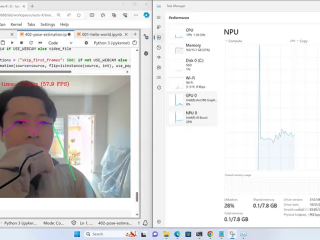

AI Windows CPU 上で torch.compile を使用して PyTorch 推論を高速化する

この記事は、インテルのウェブサイトで公開されている「Accelerate PyTorch* Inference with torch.compile on Windows* CPU」の日本語参考訳です。原文は更新される可能性があります。原文...

AI

AI  インテル® DPC++/C++ コンパイラー

インテル® DPC++/C++ コンパイラー  その他

その他  OpenVINO™ ツールキット

OpenVINO™ ツールキット  インテル® DPC++/C++ コンパイラー

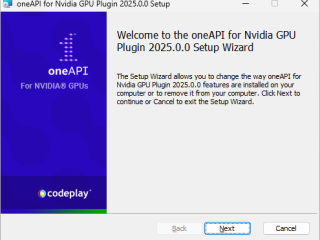

インテル® DPC++/C++ コンパイラー  インテル® oneAPI

インテル® oneAPI  AI

AI  インテル® oneAPI

インテル® oneAPI  インテル® Fortran コンパイラー

インテル® Fortran コンパイラー  インテル® Fortran コンパイラー

インテル® Fortran コンパイラー  インテル® VTune™ プロファイラー

インテル® VTune™ プロファイラー  インテル® MPI ライブラリー

インテル® MPI ライブラリー  インテル® DPC++/C++ コンパイラー

インテル® DPC++/C++ コンパイラー  インテル® oneAPI

インテル® oneAPI  インテル® DPC++/C++ コンパイラー

インテル® DPC++/C++ コンパイラー