この記事は、Medium に公開されている「How to develop and build your first AI PC app on Intel NPU (Intel AI Boost)」の日本語参考訳です。原文は更新される可能性があります。原文と翻訳文の内容が異なる場合は原文を優先してください。

この記事の PDF 版はこちらからご利用になれます。

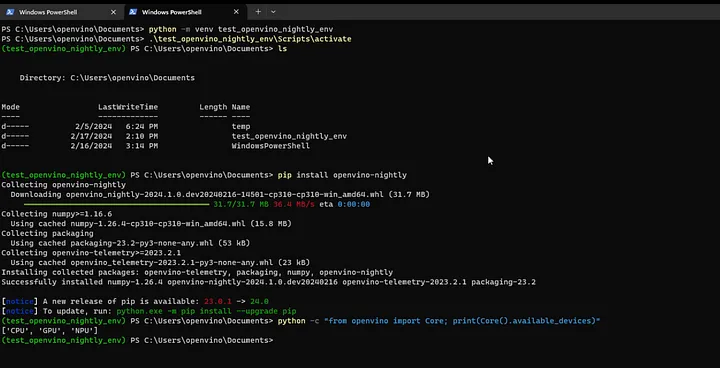

OpenVINO™ nightly ビルドに NPU プラグインがデフォルトで含まれました。

AI PC 開発環境に対応した公式リリースも利用できるようになりました。オフラインで、zip ファイルを使用してアーカイブから OpenVINO™ 2023.2 または 2023.3 LTS をインストールしてください。このパッケージを使用すると、NPU、CPU、GPU、およびインテル® Core™ Ultra プロセッサーの GNA 向けの開発が可能になります。

アーキテクチャーの特定の制限により、「すべての」モデルが NPU とシームレスに統合されるわけではないことに注意することが重要です。良いニュースもあります。VPU と Movidius™ を調べると、以前に変換したモデルが適切に機能する可能性が高いことが分かりました。ノートブックの姿勢推定と画像分類のデモをテストしたところ、適切に機能しました。ノートブックには、そのまま機能するモデルがほかにも含まれています。さらに重要なのは、NPU がサポートされていない場合、つまり CPU と GPU 上でアプリを開発した場合でも、優れたパフォーマンスが得られることです。

インテルのチームは NPU のサポートを常に更新および改善しています。問題を発見した場合は、GitHub* (英語) で報告してリクエストを追加してください。

適切に機能させるための手順を次に示します。

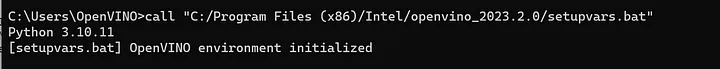

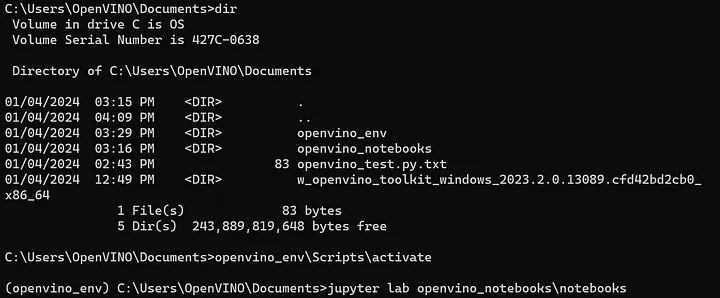

1. OpenVINO™ 2023.2 アーカイブ (英語) または OpenVINO™ 2023.3 アーカイブ (英語) をダウンロードし、指示に従ってすべてをインストールします。Windows のコマンドプロンプトを使用してください。PowerShell を使用するとインストールに失敗します。

(PowerShell ではなく) コマンドプロンプトを使用して環境を初期化します。

また、新しいコマンドプロンプトを開始するたびに、setupvars.bat を実行してください。

2. GitHub* から OpenVINO™ ノートブック (英語) をダウンロードします。重複してダウンロードしないように、requirements.txt とノートブックの先頭のすべての pip install から openvino-dev と openvino を手動で削除します。

ノートブックには、試すことができる 100 以上のデモが用意されています。NPU 上で動作するのは一部のみです。その他のデモは CPU と GPU 上で試すことができます。

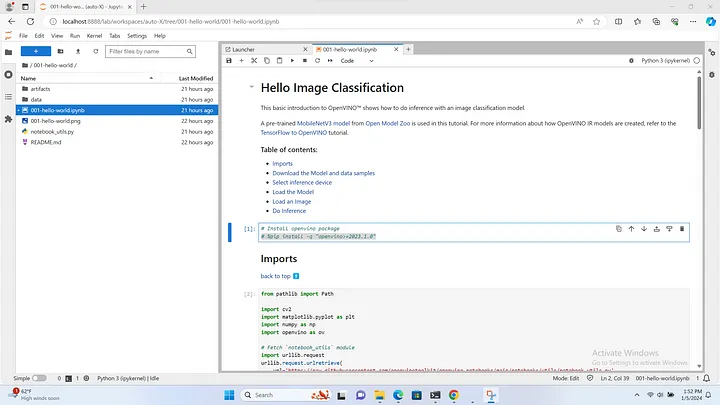

OpenVINO™ ノートブックを通常どおり実行します。ただし、pip install からではなくアーカイブから OpenVINO™ 2023.2 を使用します。

ノートブックの先頭のインストールを削除 (コメントアウト) してください。

ノートブックの先頭のインストールを削除 (コメントアウト) してください。

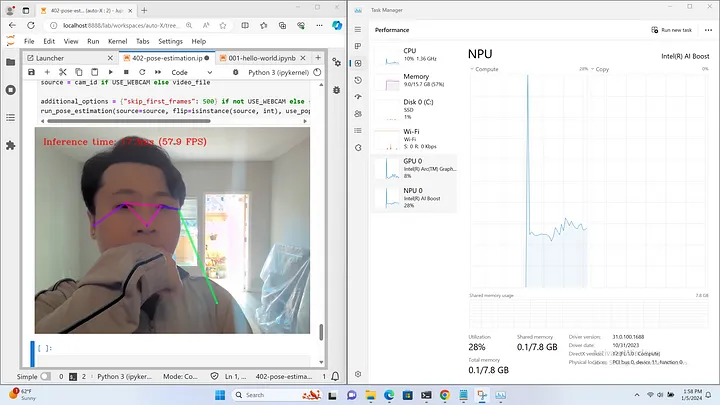

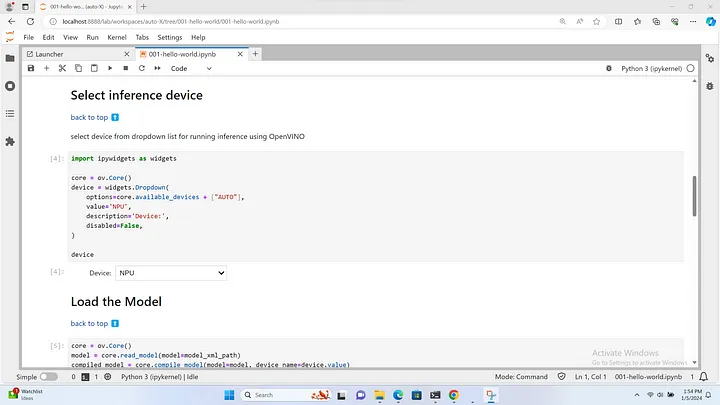

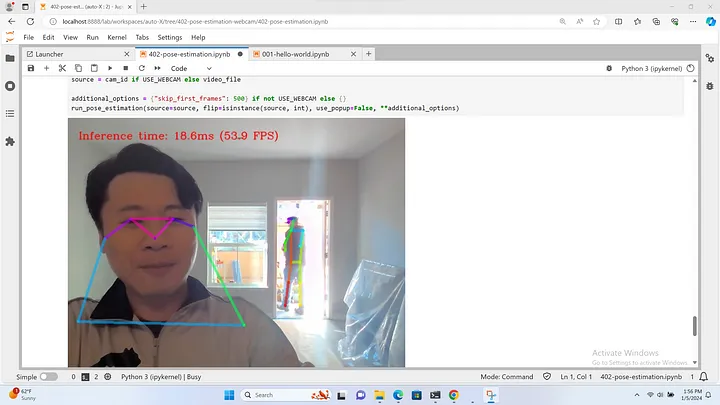

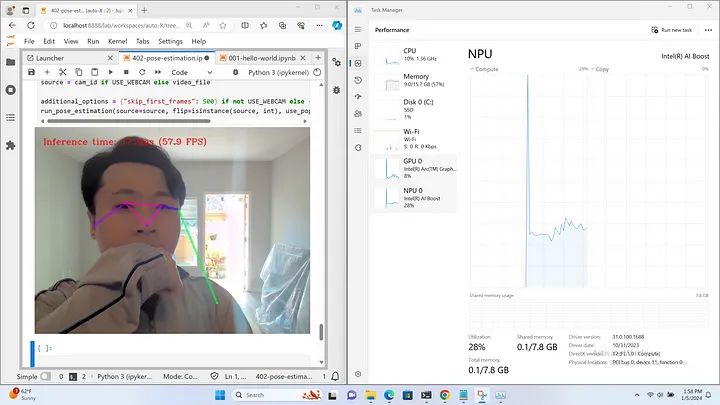

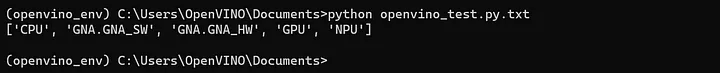

3. デバイス名を「NPU」に変更して実行します。画像分類と人間の姿勢推定のノートブックをテスト済みです。

推論デバイスとして NPU を選択します。

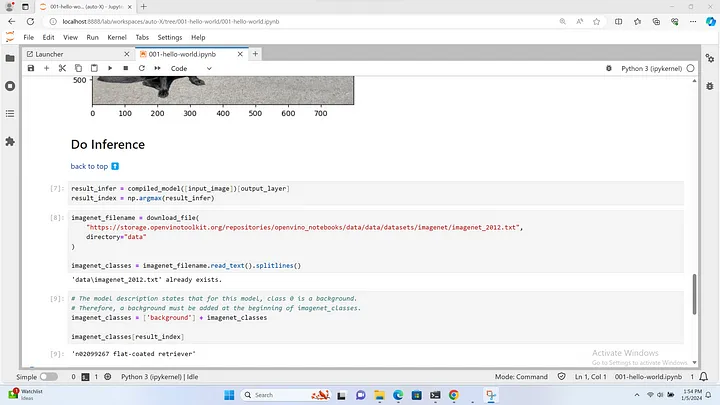

画像分類の結果です。

人間の姿勢推定を NPU 上で実行します。

低電力の推論に NPU を利用します。

これでおしまいです。Stable Diffusion、LLM チャットボット、物体検出を含む多くのサンプルを試すことができます。すべてのサンプルが NPU に対応しているわけではありませんが、ほとんどのタスクは、AI PC に搭載されている iGPU や CPU で実行できます。

インテル® Core™ Ultra プロセッサーでは多くのハードウェア・アクセラレーターを使用できます。

ニューラル・プロセシング・ユニット (NPU) の詳細を知りたい場合は、インテル® Movidius™ ビジョン・プロセシング・ユニット (VPU) の情報が参考になります。

#iamintel

OpenVINO™ ツールキットとは

AI を加速する無償のツールである OpenVINO™ ツールキットは、インテルが無償で提供しているインテル製の CPU や GPU、VPU、FPGA などのパフォーマンスを最大限に活用して、コンピューター・ビジョン、画像関係をはじめ、自然言語処理や音声処理など、幅広いディープラーニング・モデルで推論を最適化し高速化する推論エンジン / ツールスイートです。

OpenVINO™ ツールキット・ページでは、ツールの概要、利用方法、導入事例、トレーニング、ツール・ダウンロードまでさまざまな情報を提供しています。ぜひ特設サイトにアクセスしてみてください。

https://www.intel.co.jp/content/www/jp/ja/internet-of-things/openvino-toolkit.html

法務上の注意書き

インテルのテクノロジーを使用するには、対応したハードウェア、ソフトウェア、またはサービスの有効化が必要となる場合があります。

絶対的なセキュリティーを提供できる製品またはコンポーネントはありません。

実際の費用と結果は異なる場合があります。

© Intel Corporation. Intel、インテル、Intel ロゴ、その他のインテルの名称やロゴは、Intel Corporation またはその子会社の商標です。

* その他の社名、製品名などは、一般に各社の表示、商標または登録商標です。