AI

AI インテル® Xeon® プロセッサー上での SLM の最適化: llama.cpp のパフォーマンス調査

この記事は、インテルのウェブサイトで公開されている「Optimizing SLMs on Intel® Xeon® Processors: A llama.cpp Performance Study」を iSUS で翻訳した日本語参考訳です...

AI

AI  OpenVINO™ ツールキット

OpenVINO™ ツールキット  AI

AI  AI

AI  インテル® DPC++/C++ コンパイラー

インテル® DPC++/C++ コンパイラー  インテル® ディストリビューションの Python*

インテル® ディストリビューションの Python*  AI

AI  マシンラーニング

マシンラーニング  インテル® oneMKL

インテル® oneMKL  マシンラーニング

マシンラーニング  マシンラーニング

マシンラーニング  インテル® oneMKL

インテル® oneMKL  HPC

HPC  インテル® Software Development Emulator

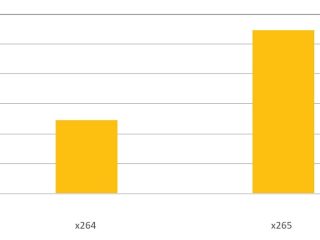

インテル® Software Development Emulator  メディア

メディア